Всем привет! Начну с важного объявления. В нашем блоге запускается проект «Технический аудит под микроскопом » и данный материал открывает цикл статей, посвященных этой теме. О чем пойдет речь сегодня? О том, как правильно написать robots.txt для сайта с нуля.

Текст советую прочесть тем, кто хочет научиться создавать текстовый файл самостоятельно, и рассмотреть принцип его работы изнутри. Информация также пригодится владельцам веб-проектов, которые стремятся продвинуть свой сайт в ТОП.

В статье ниже «под микроскопом» рассмотрены такие вопросы:

Чтобы написать статью, я потратила около 37 часов, изучила более 20 источников, посетила несколько форумов веб-мастеров. Поэтому каждое слово неоднократно проверено и перепроверено.

Итак, начнем. Чтобы ввести вас в тему и дать общее представление о robots.txt, предлагаю по традиции обратиться к ассоциациям. Представьте, что вы владелец дома, и, как водится в частном секторе, к вам постоянно кто-то из соседей приходит в гости. Как вы можете поступить? Вообще не открывать дверь никому или впускать некоторых, которые более симпатичны. При этом вы можете предоставить в распоряжение гостей весь дом или только отдельные комнаты, закрыв все личные апартаменты.

По такому принципу и работает robots.txt: что-то для кого-то открывает, а куда-то кого-то не пускает. Подробности читайте дальше в статье.

Robots.txt: что значит и как работает

Знакомство с индексным файлом логично начать с объяснения термина.

Robots.txt – текстовый документ, который говорит поисковикам, на какие данные и страницы сайта обращать внимание (индексировать, обрабатывать), а на какие нет. Его еще называют «стандартом/протоколом исключений для роботов». Он действует для протоколов https, http и FTP, использует кодировку UTF-8 Unicode.

Практически все популярные поисковые системы следуют данным стандартам: Google, Ask, Yandex, AOL, Yahoo!, Bing и др. Хотя, стоит отметить, что Гугл воспринимает их, как «рекомендации», а не как «команду». То есть, как я понимаю, хочу придерживаюсь, хочу – нет.

Где находится файл robots.txt? Его размещают в корневом каталоге веб-проекта. Визуально он выглядит так:

https://site.com.ua/robots.txt.

Принцип работы robots.txt

Говоря простыми словами, наличие robots.txt помогает установить диалог между веб-проектом и поисковыми системами (как переводчик на переговорах). При этом владелец ресурса сам решает, куда открыть доступ и куда запретить вход.

Таким образом, после сканирования индексного файла, развитие событий идет по одному из 3-х сценариев, т.е. поисковики получают:

- полный доступ ко всему веб-ресурсу;

- частичный пропуск, т.е. только к разрешенным страницам и данным;

- абсолютный запрет на вход, где сайт полностью закрыт для обработки.

Чтобы показать, как проходит индексация веб-проекта с robots.txt и без него, сделала инфографику.

Чтобы понять важность данного файла, нужно знать принцип работы поисковых систем. Итак, как же они действуют?

Робот поисковика заходит на сайт и первым делом ищет robots.txt. Если его нет или он составлен неправильно, то поисковая система начинает «руководить парадом» самостоятельно. То есть сканирует все подряд: и нужное, и ненужное. При таком подходе обработка веб-ресурса затягивается надолго и при этом не факт, что важные страницы будут первыми в очереди. Зачем такие сложности?

Кроме того, за 1 посещение роботы обрабатывают определенное число ресурсов. Какой из этого следует вывод? Меньше страниц для сканирования, больше проиндексированных и, следовательно, больше трафик. Быстрая индексация также помогает защитить новый контент и отследить, как те или иные мероприятия повлияли на позиции в выдаче.

5 основных директив для написания robots.txt

Прежде чем начать создавать файл robots.txt, нужно ознакомиться с основными командами (директивами), которые понадобятся для написания списка запретов.

Есть 5 базовых команд:

USER-AGENT

Указывает, для какого поисковика предназначаются команды, которые следуют после нее. Можно использовать символ «*» и тогда указания будут касаться всех поисковых систем. С этой директивы начинается любой индексный файл. Если она не прописана, поисковый робот считает, что все двери для него открыты.

Например:

User-agent: Google – команды для Гугл

User-agent: Yandex – команды для Яндекс

User-agent: * – команды для всех поисковиков

Обратите внимание, если робот обнаружил название своего поисковика после директивы User-agent, он проигнорирует все указания из раздела «User-agent: *».

Важно отметить, что поисковые системы имеют несколько роботов, для каждого из которых нужно прописывать команды отдельно.

Рассмотрим базовые роботы самых популярных поисковиков Гугл и Яндекс:

1. Google:

- Googlebot – основной робот поисковика;

- Googlebot-Image – сканирует изображения;

- Googlebot-Video – проверяет видеофайлы;

- Googlebot-Mobile – обрабатывает страницы для мобильных гаджетов;

- Adsbot-Google – проверяет качество рекламы на ресурсах для ПК;

- Googlebot-News – ищет страницы, чтобы добавить в Гугл Новости.

2. Yandex:

- Yandex – означает, что команды относятся ко всем роботам Яндекс;

- YandexBot – базовый бот поисковика;

- YandexImages

– обрабатывает картинки;

YandexNews – индексатор страниц, предназначенных для Яндекс Новости; - YandexMedia – сканирует мультимедийные данные;

- YandexMobileBot – проверяет документы на предмет верстки под мобильные девайсы.

Запомните, при написании файла robots.txt секции для разных ботов нужно разделять 1 пустой строкой.

В качестве памятки:

DISALLOW и ALLOW

Здесь все просто. Директива Allow разрешает поисковым ботам сканировать ресурс, Disallow – запрещает. Рассмотрим подробнее, как они работают.

Если в файле robots.txt прописать запрещающую команду Disallow или Allow, то можно:

- закрыть/открыть доступ роботов ко всему сайту, используя слэш;

Disallow: /

Allow: /

- запретить/разрешить сканирование определенных страниц, прописав адрес.

Disallow: /admin/

Allow: /admin/

- открыть/закрыть вход к конкретному файлу, указав путь:

Disallow: /razdel/file

Allow: /razdel/file

- запретить/разрешить обрабатывать документы определенного типа, используя *:

Disallow: /*png*

Allow: /*png*

Обратите внимание, чтобы закрыть/открыть страницы сайта для индексации, после данных директив robots.txt пишется не полный адрес, а лишь та часть, которая идет после домена сайта..

Как видите, все действительно просто. Как в математике: знаешь формулу – решишь задачу.

Чтобы закрепить материал, давайте разберем пример:

User-agent: *

Disallow: /

Allow: / blog/

Allow: / *.gift*

Что мы видим в фрагменте этого robots.txt: доступ открыт для всех поисковых систем, закрытыми для сканирования являются все страницы, кроме одного раздела «blog» и файлов типа «.gift».

Скачивайте картинку ниже, чтобы не забыть:

Что можно закрыть с помощью файла robots.txt и Disallow?

Все, конечно, зависит от пожеланий владельца веб-проекта, но есть несколько общих рекомендаций.

Посредством robots.txt советуют запретить индексацию ресурсов с:

- административной частью (иначе говоря, админку);

- личными данными пользователей;

- неполезным, неактуальным или неуникальным контентом (чек-лист для проверки);

- многоуровневыми формами регистрации, обратной связи, заказа и корзиной;

- тегами, результатами поиска по сайту, фильтрами.

Делаем вывод – в файле robots.txt нужно закрыть те страницы сайта, которые не важны, не нужны или не должны быть показаны пользователям и поисковикам.

Кстати, статья о контенте: «2 вида визуального контента »

SITEMAP

Еще один директив, который должен быть написан в файле robots.txt – Sitemap. Для чего он служит? Чтобы показать поисковым ботам путь к Карте сайта. Разберем вопрос в деталях.

Карта сайта – это файл в формате xml с кодировкой UTF8, который хранится в корневой директории веб-ресурса. Он представляет собой своеобразный каталог с ссылками, что ведут на разные страницы. При составлении Карты важно вносить только те ресурсы, которые нуждаются в индексе, исключая с динамическим URL и тегами.

Основные требования к файлу смотрите ниже:

Как директива Sitemap помогает в индексации?

Вспоминаем принцип работы поисковых ботов: зашли на сайт, откинули закрытые страницы и далее, если нет данной команды, начинают хаотично рыскать по сайту. Так как время на сканирование одного веб-проекта ограничено, робот может так и не дойти до действительно важных ресурсов. Особенно это касается «больших» сайтов, где много страниц и переходов по ссылкам.

Будет интересно прочесть: «Покупка вечных ссылок: 4 шага от хаоса к порядку »

Здесь как раз и приходит на помощь директива Sitemap. Она провожает робота к Карте сайта, где указано, какие ресурсы нужно проиндексировать и какие являются самыми важными, а также как часто должна обновляться информация. Такая индексация 100% более качественная и быстрее в 3,14 раза.

Вот как выглядит готовая Карта сайта (фрагмент):

Как создать Карту сайта?

Идеальный вариант воспользоваться бесплатными онлайн-генераторами.

Вот список протестированных мной сервисов:

- XML-Sitemaps.com. Бесплатно создает Sitemap для сайтов, содержащих до 500 страниц. Время работы – 2-3 минуты. Предлагает скачать файл в формате XML Document. Не требует регистрации. Интерфейс на английском языке.

- mysitemapgeneration . Для бесплатного пакета ограничение – до 500 страниц. Создание Карты сайта занимает всего пару минут. Готовый файл в формате xml отправляется на почту. Сайт русифицирован, простой и понятный. Регистрироваться не нужно.

- Xml Sitemap Generator . Англоязычный ресурс с лимитом до 2000 страниц. Скачать файл можно в нескольких форматах: xml, rss, html, txt. Создание Карты сайта проходит также быстро и без регистрации.

- Majento. Русскоязычный оперативный сайт, не требующий регистрации. Лимиты бесплатного пакета: до 1000 страниц, 5 раз/сутки для одного IP-адреса. Можно определить параметры отчета и установить фильтр на страницы с определенным расширением. Готовую Карту сайта можно скачать в формате xml.

Все сервисы справляются с созданием Sitemap на отлично. Кроме представленных онлайн-генераторов, есть также множество других: Small Seo Tools, Screamingfrog, xSitemap.com, Free Sitemap Generator и т.д. Выбирайте самый оптимальный для себя и делайте Карты сайта без проблем.

Узнайте также о 5 лучших сервисах для работы копирайтера с текстом

В готовом файле, кроме URL-адресов, вы увидите несколько команд, расшифровать которые поможет следующая картинка:

Карта сайта готова. Что дальше?

Нужно оповестить об этом поисковые системы. Конечно, поисковики со временем сами обнаружат этот файл, но для ускорения процесса лучше сразу показать им путь.

Вот 2 самых простых способа рассказать поисковым ботам о Карте сайта:

- Добавить ссылку на адрес файла, используя панель инструментов вебмастеров от Google и Yandex. В Яндекс.Вебмастер нужно: нажать на вкладку «Индексирование», далее на «Файлы Sitemap» и ввести URL. Для Гугл: открываем Google Search Console, кликаем на «Сканирование», затем на «Файлы Sitemap», вставляем и отправляем адрес.

- Вставить в файл robots.txt ссылку на месторасположение файла Sitemap. Визуально это выглядит так: Sitemap: https://site.com/sitemap.xml

Важный совет в заключении – желательно добавлять Sitemap после каждой публикации новой информации на сайте.

Как еще ускорить индексацию читайте:

«Как разместить и ускорить индексацию статьи? 5 секретов успеха »

HOST

Последней неотъемлемой частью robots.txt была директива Host. Она показывала поисковому роботу, какое зеркало (алиас) веб-проекта является основным: с префиксом www или без. Воспринималась данная команда только поисковиком Yandex и была актуальной исключительно для сайтов, имеющих «копии».

Примечание : зеркало сайта представляет собой полную или частичную копию интернет-проекта, которая имеет свой домен и находится на отдельном ресурсе.

Выглядело это примерно так:

Почему все в прошедшем времени, спросите вы. Ответ простой – 20 марта 2018 года Яндекс официально объявил про отказ от директивы Host. Теперь данная команда должна быть заменена редиректом 301 через файл.htaccess. Директиву Host нужно просто удалить из индексного файла. Хотя, если она присутствует, ничего страшного не произойдет, т.к. Яндекс теперь ее просто игнорирует.

Использование редиректа 301 для определения основного сайта является универсальным способом, т.к. воспринимается всеми поисковыми ботами. Детально, как поставить 301-й редирект будет рассказано в следующей статье. Следите за новинками в блоге, посещая сайт или через ленту новостей в

Поисковые роботы - краулеры начинают знакомство с сайтом с чтения файла robots.txt. В нем содержится вся важная для них информация. Владельцам сайтов следует создать и периодически проводить анализ robots.txt. От корректности его работы зависит скорость индексации страниц и место в поисковой выдачи.

Он не является обязательным элементом сайта, но его наличие желательно, потому что с его помощью владельцы сайта управляют поисковыми роботами. Задавайте разные уровни доступа к сайту, запрет на индексацию всего сайта, отдельных страниц, разделов или файлов. Для ресурсов с высокой посещаемостью ограничивайте время индексации и запрещайте доступ роботов, которые не относятся к основным поисковым системам. Это уменьшит нагрузку на сервер.

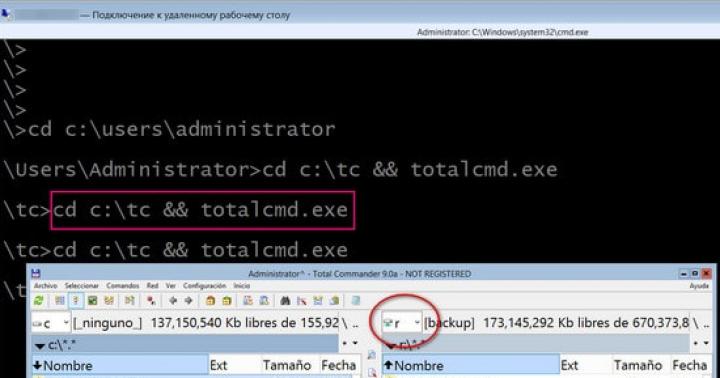

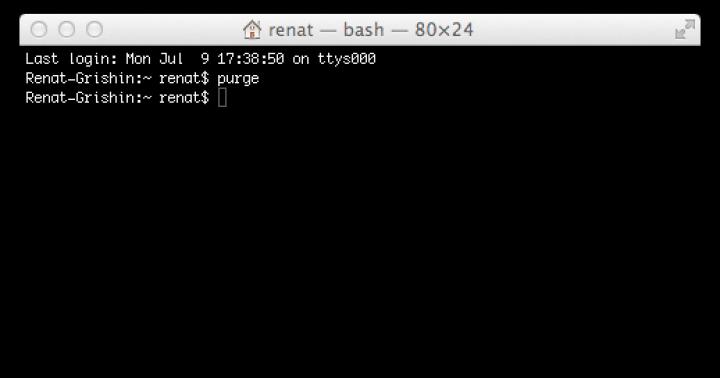

Создание. Создают файл в текстовом редакторе Notepad или подобных. Следите за тем, чтобы размер файла не превышал 32 КБ. Выбирайте для файла кодировку ASCII или UTF-8. Учтите, что файл должен быть единственным. Если сайт создан на CMS, то он будет генерироваться автоматически.

Разместите созданный файл в корневой директории сайта рядом с основным файлом index.html. Для этого используют FTP доступ. Если сайт сделан на CMS, то с файлом работают через административную панель. Когда файл создан и работает корректно, он доступен в браузере.

При отсутствии robots.txt поисковые роботы собирают всю информацию, относящуюся к сайту. Не удивляйтесь, когда увидите в выдаче незаполненные страницы или служебную информацию. Определите, какие разделы сайта будут доступны пользователям, остальные - закройте от индексации.

Проверка. Периодически проверяйте, все ли работает корректно. Если краулер не получает ответ 200 ОК, то он автоматически считает, что файла нет, и сайт открыт для индексации полностью. Коды ошибок бывают такими:

3хх - ответы переадресации. Робота направляют на другую страницу или на главную. Создавайте до пяти переадресаций на одной странице. Если их будет больше, робот пометит такую страницу как ошибку 404. То же самое относится и к переадресации по принципу бесконечного цикла;

4хх - ответы ошибок сайта. Если краулер получает от файла robots.txt 400-ую ошибку, то делается вывод, что файла нет и весь контент доступен. Это также относится к ошибкам 401 и 403;

5хх - ответы ошибок сервера. Краулер будет «стучаться», пока не получит ответ, отличный от 500-го.

Правила создания

Начинаем с приветствия. Каждый файл должен начинаться с приветствия User-agent. С его помощью поисковики определят уровень открытости.

| Код | Значение |

| User-agent: * | Доступно всем |

| User-agent: Yandex | Доступно роботу Яндекс |

| User-agent: Googlebot | Доступно роботу Google |

| User-agent: Mail.ru | Доступно роботу Mail.ru |

Добавляем отдельные директивы под роботов. При необходимости добавляйте директивы для специализированных поисковых ботов Яндекса.

Однако в этом случае директивы * и Yandex не будут учитываться.

У Google собственные боты:

Сначала запрещаем, потом разрешаем. Оперируйте двумя директивами: Allow - разрешаю, Disallow - запрещаю. Обязательно укажите директиву disallow, даже если доступ разрешен ко всему сайту. Такая директива является обязательной. В случае ее отсутствия краулер может не верно прочитать остальную информацию. Если на сайте нет закрытого контента, оставьте директиву пустой.

Работайте с разными уровнями. В файле можно задать настройки на четырех уровнях: сайта, страницы, папки и типа контента. Допустим, вы хотите закрыть изображения от индексации. Это можно сделать на уровне:

- папки - disallow: /images/

- типа контента - disallow: /*.jpg

| Нет | Да |

| Disallow: Yandex |

User-agent: Yandex Disallow: / |

| Disallow: /css/ /images/ |

Disallow: /css/ Disallow: /images/ |

Пишите с учетом регистра.

Имя файла укажите строчными буквами. Яндекс в пояснительной документации указывает, что для его ботов регистр не важен, но Google просит соблюдать регистр. Также вероятна ошибка в названиях файлов и папок, в которых учитывается регистр.

Укажите 301 редирект на главное зеркало сайта . Раньше для этого использовалась директива Host, но с марта 2018 г. она больше не нужна. Если она уже прописана в файле robots.txt, удалите или оставьте ее на свое усмотрение; роботы игнорируют эту директиву.

Для указания главного зеркала проставьте 301 редирект на каждую страницу сайта. Если редиректа стоят не будет, поисковик самостоятельно определит, какое зеркало считать главным. Чтобы исправить зеркало сайта, просто укажите постраничный 301 редирект и подождите несколько дней.

Пропишите директиву Sitemap (карту сайта). Файлы sitemap.xml и robots.txt дополняют друг друга. Проверьте, чтобы:

- файлы не противоречили друг другу;

- страницы были исключены из обоих файлов;

- страницы были разрешены в обоих файлах.

Указывайте комментарии через символ #. Все, что написано после него, краулер игнорирует.

Проверка файла

Проводите анализ robots.txt с помощью инструментов для разработчиков: через Яндекс.Вебмастер и Google Robots Testing Tool. Обратите внимание, что Яндекс и Google проверяют только соответствие файла собственным требованиям. Если для Яндекса файл корректный, это не значит, что он будет корректным для роботов Google, поэтому проверяйте в обеих системах.

Если вы найдете ошибки и исправите robots.txt, краулеры не считают изменения мгновенно. Обычно переобход страниц осуществляется один раз в день, но часто занимает гораздо большее время. Проверьте через неделю файл, чтобы убедиться, что поисковики используют новую версию.

Проверка в Яндекс.Вебмастере

Сначала подтвердите права на сайт. После этого он появится в панели Вебмастера. Введите название сайта в поле и нажмите проверить. Внизу станет доступен результат проверки.

Дополнительно проверяйте отдельные страницы. Для этого введите адреса страниц и нажмите «проверить».

Проверка в Google Robots Testing Tool

Позволяет проверять и редактировать файл в административной панели. Выдает сообщение о логических и синтаксических ошибках. Исправляйте текст файла прямо в редакторе Google. Но обратите внимание, что изменения не сохраняются автоматически. После исправления robots.txt скопируйте код из веб-редактора и создайте новый файл через блокнот или другой текстовый редактор. Затем загрузите его на сервер в корневой каталог.

Запомните

Файл robots.txt помогает поисковым роботам индексировать сайт. Закрывайте сайт во время разработки, в остальное время - весь сайт или его часть должны быть открыты. Корректно работающий файл должен отдавать ответ 200.

Файл создается в обычном текстовом редакторе. Во многих CMS в административной панели предусмотрено создание файла. Следите, чтобы размер не превышал 32 КБ. Размещайте его в корневой директории сайта.

Заполняйте файл по правилам. Начинайте с кода “User-agent:”. Правила прописывайте блоками, отделяйте их пустой строкой. Соблюдайте принятый синтаксис.

Разрешайте или запрещайте индексацию всем краулерам или избранным. Для этого укажите название поискового робота или поставьте значок *, который означает «для всех».

Работайте с разными уровнями доступа: сайтом, страницей, папкой или типом файлов.

Включите в файл указание на главное зеркало с помощью постраничного 301 редиректа и на карту сайта с помощью директивы sitemap.

Для анализа robots.txt используйте инструменты для разработчиков. Это Яндекс.Вебмастер и Google Robots Testing Tools. Сначала подтвердите права на сайт, затем сделайте проверку. В Google сразу отредактируйте файл в веб-редакторе и уберите ошибки. Отредактированные файлы не сохраняются автоматически. Загружайте их на сервер вместо первоначального robots.txt. Через неделю проверьте, используют ли поисковики новую версию.

Материал подготовила Светлана Сирвида-Льорентэ.

Последовательно заполняйте все необходимые поля. По мере ваших указаний, Вы будете видеть наполнение вашего Robots.txt директивами. Ниже подробно описаны все директивы файла Robots.txt.

Пометьте , скопируйте и вставьте текст в текстовый редактор. Сохраните файл как "robots.txt" в корневой директории Вашего сайта.

Описание формата файла robots.txt

Файл robots.txt состоит из записей, каждая из которых состоит из двух полей: строки с названием клиентского приложения (user-agent), и одной или нескольких строк, начинающихся с директивы Disallow:

Директива ":" значение

Robots.txt должен создаваться в текстовом формате Unix. Большинство хороших текстовых редакторов уже умеют превращать символы перевода строки Windows в Unix. Либо ваш FTP-клиент должен уметь это делать. Для редактирования не пытайтесь пользоваться HTML-редактором, особенно таким, который не имеет текстового режима отображения кода.

Директива User-agent :

Для Рамблера: User-agent: StackRambler Для Яндекса: User-agent: Yandex Для Гугла: User-Agent: googlebotВы можете создать инструкцию для всех роботов:

User-agent: *

Директива Disallow :

Вторая часть записи состоит из строк Disallow . Эти строки - директивы (указания, команды) для данного робота. В каждой группе, вводимой строкой User-agent, должна быть хотя бы одна инструкция Disallow . Количество инструкций Disallow не ограничено.Они сообщают роботу какие файлы и/или каталоги роботу неразрешено индексировать. Вы можете запретить индексацию файла или каталога.

Следующая директива запрещает индексацию каталога /cgi-bin/:

Disallow: /cgi-bin/ Обратите внимание на / в конце названия директории! Чтобы запрещать посещение именно каталога "/dir" , инструкция должна иметь вид: "Disallow: /dir/" . А строка "Disallow: /dir" запрещает посещение всех страниц сервера, полное имя которых (от корня сервера) начинается с "/dir". Например: "/dir.html", "/dir/index.html", "/directory.html".

Записанная следующим образом директива запрещает индексацию файла index.htm находящегося в корне:

Disallow: /index.htm

Директиву Allow понимает только Яндекс.

User-agent: Yandex Allow: /cgi-bin Disallow: / # запрещает скачивать все, кроме страниц начинающихся с "/cgi-bin" Для остальных поисковиков вам придется перечислять все закрытые документы. Продумайте структуру сайта, чтобы закрытые для индексирования документы были собраны по возможности в одном месте.

Если директива Disallow будет пустой, это значит, что робот может индексировать ВСЕ файлы. Как минимум одна директива Disallow должна присутствовать для каждого поля User-agent , чтобы robots.txt считался верным. Полностью пустой robots.txt означает то же самое, как если бы его не было вообще.

Робот Рамблера понимает * как любой символ, поэтому инструкция Disallow: * означает запрещение индексации всего сайта.

Директивы Allow, Disallow без параметров. Отсутствие параметров у директив Allow , Disallow трактуется следующим образом: User-agent: Yandex Disallow: # тоже что и Allow: / User-agent: Yandex Allow: # тоже что и Disallow: /

Использование спецсимволов "*" и "$"

.

При указании путей директив Allow-Disallow можно использовать спецсимволы "*" и "$",

задавая, таким образом, определенные регулярные выражения. Спецсимвол "*" означает любую

(в том числе пустую) последовательность символов. Примеры:

User-agent: Yandex

Disallow: /cgi-bin/*.aspx # запрещает "/cgi-bin/example.aspx"

и "/cgi-bin/private/test.aspx"

Disallow: /*private # запрещает не только "/private",

но и "/cgi-bin/private"

Спецсимвол "$"

.

По умолчанию к концу каждого правила, описанного в robots.txt, приписывается "*", например:

User-agent: Yandex

Disallow: /cgi-bin* # блокирует доступ к страницам начинающимся с "/cgi-bin"

Disallow: /cgi-bin # то же самое

чтобы отменить "*" на конце правила, можно использовать спецсимвол "$", например:

User-agent: Yandex

Disallow: /example$ # запрещает "/example", но не запрещает "/example.html"

User-agent: Yandex

Disallow: /example # запрещает и "/example", и "/example.html"

User-agent: Yandex

Disallow: /example$ # запрещает только "/example"

Disallow: /example*$ # так же, как "Disallow: /example"

запрещает и /example.html и /example

Директива Host .

Если ваш сайт имеет зеркала, специальный робот зеркальщик определит их и сформирует группу зеркал вашего сайта. В поиске будет участвовать только главное зеркало. Вы можете указать его при помощи robots.txt, используя директиву "Host", определив в качестве ее параметра имя главного зеркала. Директива "Host" не гарантирует выбор указанного главного зеркала, тем не менее, алгоритм при принятии решения учитывает ее с высоким приоритетом. Пример: #Если www.glavnoye-zerkalo.ru главное зеркало сайта, то robots.txt для #www.neglavnoye-zerkalo.ru выглядит так User-Agent: * Disallow: /forum Disallow: /cgi-bin Host: www.glavnoye-zerkalo.ru В целях совместимости с роботами, которые не полностью следуют стандарту при обработке robots.txt, директиву "Host" необходимо добавлять в группе, начинающейся с записи "User-Agent", непосредственно после директив "Disallow"("Allow"). Аргументом директивы "Host" является доменное имя с номером порта (80 по умолчанию), отделенным двоеточием. Параметр директивы Host обязан состоять из одного корректного имени хоста (т.е. соответствующего RFC 952 и не являющегося IP-адресом) и допустимого номера порта. Некорректно составленные строчки "Host:" игнорируются.Примеры игнорируемых директив Host:

Host: www.myhost-.ru Host: www.-myhost.ru Host: www.myhost.ru:100000 Host: www.my_host.ru Host: .my-host.ru:8000 Host: my-host.ru. Host: my..host.ru Host: www.myhost.ru/ Host: www.myhost.ru:8080/ Host: 213.180.194.129 Host: www.firsthost.ru,www.secondhost.ru # в одной строке - один домен! Host: www.firsthost.ru www.secondhost.ru # в одной строке - один домен!! Host: экипаж-связь.рф # нужно использовать punycodeДиректива Crawl-delay

Задает таймаут в секундах, с которым поисковый робот закачивает страницы с вашего сервера (Crawl-delay).

Если сервер сильно нагружен и не успевает отрабатывать запросы на закачку, воспользуйтесь директивой "Crawl-delay". Она позволяет задать поисковому роботу минимальный период времени (в секундах) между концом закачки одной страницы и началом закачки следующей. В целях совместимости с роботами, которые не полностью следуют стандарту при обработке robots.txt, директиву "Crawl-delay" необходимо добавлять в группе, начинающейся с записи "User-Agent", непосредственно после директив "Disallow" ("Allow").

Поисковый робот Яндекса поддерживает дробные значения Crawl-Delay, например, 0.5. Это не гарантирует, что поисковый робот будет заходить на ваш сайт каждые полсекунды, но дает роботу больше свободы и позволяет ускорить обход сайта.

User-agent: Yandex Crawl-delay: 2 # задает таймаут в 2 секунды User-agent: * Disallow: /search Crawl-delay: 4.5 # задает таймаут в 4.5 секунды

Директива Clean-param

Директива для исключения параметров из адресной строки. т.е. запросы содержащие такой параметр и не содержащие - будут считаться идентичными.

Пустые строки и комментарии

Пустые строки допускаются между группами инструкций, вводимыми User-agent .

Инструкция Disallow учитывается, только если она подчинена какой-либо строке User-agent - то есть если выше нее есть строка User-agent .

Любой текст от знака решетки " # " до конца строки считается комментарием и игнорируется.

Пример:

Следующий простой файл robots.txt запрещает индексацию всех страниц сайта всем роботам, кроме робота Рамблера, которому, наоборот, разрешена индексация всех страниц сайта.

# Инструкции для всех роботов User-agent: * Disallow: / # Инструкции для робота Рамблера User-agent: StackRambler Disallow:

Распространенные ошибки:

Перевернутый синтаксис: User-agent: / Disallow: StackRambler А должно быть так: User-agent: StackRambler Disallow: / Несколько директив Disallow в одной строке: Disallow: /css/ /cgi-bin/ /images/ Правильно так: Disallow: /css/ Disallow: /cgi-bin/ Disallow: /images/- Примечания:

- Недопустимо наличие пустых переводов строки между директивами "User-agent" и "Disallow" ("Allow"), а также между самими "Disallow" ("Allow") директивами.

- В соответствии со стандартом перед каждой директивой "User-agent" рекомендуется вставлять пустой перевод строки.

Robots.txt is a text file that contains site indexing parameters for the search engine robots.

Recommendations on the content of the file

Yandex supports the following directives:

| Directive | What it does |

|---|---|

| User-agent * | |

| Disallow | |

| Sitemap | |

| Clean-param | |

| Allow | |

| Crawl-delay | We recommend using the crawl speed setting |

| Directive | What it does |

|---|---|

| User-agent * | Indicates the robot to which the rules listed in robots.txt apply. |

| Disallow | Prohibits indexing site sections or individual pages. |

| Sitemap | Specifies the path to the Sitemap file that is posted on the site. |

| Clean-param | Indicates to the robot that the page URL contains parameters (like UTM tags) that should be ignored when indexing it. |

| Allow | Allows indexing site sections or individual pages. |

| Crawl-delay | Specifies the minimum interval (in seconds) for the search robot to wait after loading one page, before starting to load another. We recommend using the crawl speed setting in Yandex.Webmaster instead of the directive. |

* Mandatory directive.

You"ll most often need the Disallow, Sitemap, and Clean-param directives. For example:

User-agent: * #specify the robots that the directives are set for Disallow: /bin/ # disables links from the Shopping Cart. Disallow: /search/ # disables page links of the search embedded on the site Disallow: /admin/ # disables links from the admin panel Sitemap: http://example.com/sitemap # specify for the robot the sitemap file of the site Clean-param: ref /some_dir/get_book.pl

Robots from other search engines and services may interpret the directives in a different way.

Note. The robot takes into account the case of substrings (file name or path, robot name) and ignores the case in the names of directives.

Using Cyrillic characters

The use of the Cyrillic alphabet is not allowed in the robots.txt file and server HTTP headers.

For domain names, use Punycode . For page addresses, use the same encoding as that of the current site structure.

Привет, начинающим вебмастерам!

После двух подготовительных уроков ( и ) можем переходить к практической части, а вернее к подготовке сайта к продвижению. Сегодня мы разберем вопрос: как создать robots.txt?

robots.txt – это файл в котором содержатся параметры индексирования для поисковых систем.

Создание этого файла является одним из первых шагов к SEO-продвижению. И вот почему.

Для чего нужен robots.txt?

После того, как вы добавите свой сайт в Яндекс и Google (мы пока это не проходили), ПС начнут индексировать все, абсолютно все, что находится в вашей папке с сайтом на сервере. Это не очень хорошо с точки зрения продвижения, ведь в папке содержится очень много не нужного для ПС “мусора”, что негативно скажется на позициях в поисковой выдаче.

Именно файл robots.txt запрещает индексирование документов, папок и ненужных страниц. Кроме всего прочего, здесь указывается путь к карте сайта (тема следующего урока) и главный адрес, об чуть подробнее.

О карте сайта я говорить много не буду, скажу лишь одно: карта сайта улучшает индексацию сайта. А вот про главный адрес стоит поговорить подробнее. Дело в том, что каждый сайт изначально имеет несколько зеркал (копий сайта) и доступны по различным адресам:

- www.сайт

- сайт

- сайт/

- www.сайт/

При наличии всех этих зеркал сайт становится не уникальным. Естественно, ПС не любят не уникальный контент, не давая таким сайтам подниматься в поисковой выдаче.

Как заполнить файл robots.txt?

Любой файл, предназначенный для работы с различными внешними сервисами, в нашем случае поисковыми системами, должен иметь правила заполнения (синтаксис). Вот правила для robots:

- Название файла robots.txt должно начинаться именно с маленькой буквы. Не нужно называть его ни Robots.txt, ни ROBOTS.TXT. Правильно: robots.txt ;

- Текстовый формат “Unix”. Формат свойственен обычному блокноту в Windows, поэтому создать robots.txt достаточно просто;

Операторы robots

А сейчас поговорим, собственно, о самих операторах robots. Всего их около 6 по-моему, но необходимыми являются только 4:

- User-agent . Данный оператор используется для указания поисковой системы, к которой адресуются правила индексации. С его помощью можно указывать разные правила разным ПС. Пример заполнения: User-agent: Yandex ;

- Disallow . Оператор, запрещающий индексацию той или папки, страницы, файла. Пример заполнения: Disallow: /page.html ;

- Host . Этим оператором указывается главный адрес (домен) сайта. Пример заполнения: Host: сайт ;

- Sitemap . Указывает на адрес карты сайта. Пример заполнения: Sitemap: сайт/sitemap.xml ;

Таким образом я запретил Яндексу индексировать страницу “page.. Теперь поисковый робот Яндекса учтет эти правила и страницы “page.html” никогда не будет в индексе.

User-agent

Как уже было сказано выше, в User-agent указывается поисковая система, к которой будут использованы правила индексации. Вот небольшая табличка:

| Поисковая система | Параметр User-agent |

| Яндекс | Yandex |

| Mail.ru | Mail.ru |

| Rambler | StackRambler |

Если вы хотите, чтобы правила индексации применялись для всех ПС, то нужно сделать такую запись:

User-agent: *

То есть, использовать, как параметр, обычную звездочку.

Disallow

С этим оператором чуть посложнее, поэтому нужно быть осторожным с его заполнением. Прописывается после оператора “User-agent”. Любая ошибка может привести к очень плачевным последствиям.

| Что запрещаем? | Параметр | Пример |

| Индексацию сайта | / | Disallow: / |

| Файл в корневом каталоге | /имя файла | Disallow: /page.html |

| Файл по определенному адресу | /путь/имя файла | Disallow: /dir/page.html |

| Индексация папки | /имя папки/ | Disallow: /papka/ |

| Индексация папки по определенному адресу | /путь/имя папки/ | Disallow: /dir/papka/ |

| Документы, начинающиеся с определенного набора символов | /символы | /symbols |

| Документы, начинающиеся с определенного набора символов по адресу | /путь/символы | /dir/symbols |

Еще раз говорю: будьте крайне внимательны при работе с данным оператором. Случается и такое, что чисто случайно человек запрещает индексацию своего сайта, а потом удивляется тому, что его нет в поиске.

Про остальные операторы говорить смысла нет. Того, что написано выше вполне достаточно.

Вам, наверное, хотелось бы получить пример robots.txt? Ловите:

User-agent: * Disallow: /cgi-bin Disallow: /wp-admin Disallow: /wp-includes Disallow: /wp-content/plugins Disallow: /wp-content/cache Disallow: /wp-content/themes Disallow: /trackback Disallow: */trackback Disallow: */*/trackback Disallow: */*/feed/*/ Disallow: */feed Disallow: /tag Host: site.ru Sitemap:site.ru/sitemap.xml

Кстати, этот пример могут использовать, как настоящий файл robots.txt, люди, чьи сайты работают на WordPress. Ну а те, у кого обычные сайты, пишите сами, ха-ха-ха. К сожалению, одного единственного для всех не существует, у каждого он свой. Но с той информацией, которую я вам дал, создать robots.txt не составит большого труда.

До свидания, друзья!